Da je Microsoftov Copilot zapravo jedna velika šala, složit će se većina onih koji su ovaj AI alat čak i kraće vrijeme koristili za nekakav ozbiljan posao. Međutim, malo tko je mogao pomisliti da će i sam Microsoft to priznati.

Naime, Google, OpenAI i drugi AI igrači barem na papiru pokušavaju balansirati između marketinga i stvarnosti: hvale se „pametnim asistentima“, ali u fusnotama ipak priznaju da modeli haluciniraju, griješe i da ih treba provjeravati. Microsoft je s Copilotom uspio otići korak dalje, pa i sam sebi skočiti u usta. Dok reklame obećavaju pomoć pri kreiranju poslovnih strategija, službeni uvjeti korištenja korisniku praktički poručuju: Ovo je zabava, ne oslanjaj se ni na što ozbiljno.

Kao korisnici smo u međuvremenu naučili osnovna „pravila preživljavanja“ u eri generativne umjetne inteligencije: sve što AI kaže treba provjeriti, nikad mu ne vjerovati na riječ i uvijek imati na umu da će vrlo uvjerljivo izgovoriti i potpune besmislice. Veliki igrači to znaju pa u dokumentaciji ostavljaju jasne napomene da se radi o alatima koji mogu griješiti i da je ljudska provjera nužna.

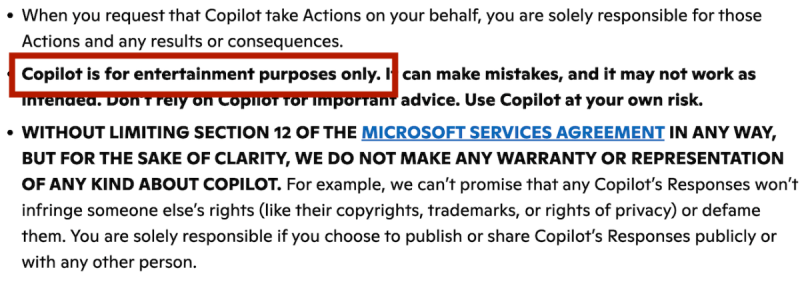

Microsoft s Copilotom, barem na površini, igra istu igru: u komunikaciji naglašava sve što Copilot može – od pisanja mailova do „pomoći pri donošenju ključnih poslovnih odluka“. Problem nastaje kada zavirite u Copilot Uvjete korištenja. Tamo vas dočeka rečenica koja ruši cijelu priču: „Copilot je samo za zabavu.“ Za ne povjerovati.

Dakle, Microsoft se služi pravnom gimnastikom, sličnom onoj koju koriste nadri-doktori i ostali šarlatani kako bi izbjegli tužbe žrtava koje u nekom trenutku shvate da su preveslane.

Drugim riječima, ono što vam se u oglasu prodaje kao ozbiljan poslovni asistent, u pravnom dokumentu preko noći postaje sprdnja.

Da ne bi bilo zabune, Microsoft odmah nastavlja: Copilot „može raditi pogreške“, „možda neće raditi kako je namijenjeno“ i „ne smijete se oslanjati na Copilot za važne savjete – koristite ga na vlastiti rizik“. Taj dio je zapravo u skladu s onim što i ostale AI tvrtke govore: ne donosite medicinske, financijske ili pravne odluke samo na temelju AI‑odgovora. No zajedno s formulacijom „for entertainment purposes only“ dobivamo eksplozivnu kombinaciju: Microsoft agresivno gura Copilot u ozbiljne poslovne i produktivne scenarije, ali se pravno kompletno ograđuje od bilo kakve stvarne odgovornosti.

Rezultat je potpuni raskorak između marketinga i pravnog teksta. S jedne strane, Copilot se integrira duboko u Windows, Office i poslovne procese, prodaje se kao „AI kopilot“ za rad i produktivnost. S druge, uvjeti korištenja tretiraju ga kao nešto što ne biste smjeli koristiti ni za iole ozbiljan savjet, a kamoli za odluke koje imaju financijske, pravne ili organizacijske posljedice. Ako ste tvrtka koja plaća enterprise licencu i na temelju Copilota automatizira generiranje koda, ugovora ili komunikacije prema klijentima, Microsoft vam poručuje: sve to radite isključivo na vlastiti rizik.

Može se, naravno, argumentirati da je ovo klasični pravnički refleks – maksimalno zaštititi kompaniju od potencijalnih tužbi. No način na koji je to formulirano ostavlja dojam da ni sam Microsoft ne vjeruje u proizvod koji istovremeno pokušava gurnuti u svaku poru svog ekosustava.

Posebno ironično zvuči činjenica da se isti taj Copilot koristi upravo za generiranje pravnih dokumenata, internih politika i osjetljive dokumentacije, dok vas uvjeti upozoravaju da bilo kakav savjet ne uzimate za ozbiljno.

U praksi, ova kontradikcija otvara dva problema. Prvi je pitanje povjerenja: ako proizvođač u uvjetima hladno kaže da je alat „samo za zabavu“, koliko ozbiljno biste vi trebali shvatiti sve ostale poruke o „AI‑revoluciji u poslovanju“? Drugi je pitanje odgovornosti: tvrtke i korisnici već sada realno koriste Copilot za stvari koje su daleko od „zabave. Ako nešto pođe po zlu, Microsoft je papirnato čist, a sav teret odgovornosti prebacuje se na krajnjeg korisnika.

U konačnici, Microsoft je ovom formulacijom postigao upravo suprotno od onoga što je vjerojatno želio: umjesto diskretne pravne zaštite, dobio je javnu sprdnju i još jedan argument kritičarima koji tvrde da su trenutni AI alati prenapuhani, nedovoljno pouzdani i, iz perspektive samih proizvođača, nepreporučljivi za išta važnije od „igranja“ po chatu. Ironično, možda bi bilo dobro da sljedeću verziju uvjeta korištenja najprije prebaci kroz vlastiti Copilot?